今回は最長距離法を使ってクラスタリングをします。

最長距離法は完全リンク法(complete_linkage)と呼ばれることもあり、各クラスタにおいて一番遠い点同士の距離をクラスタの距離とする方法です。

データセットの準備

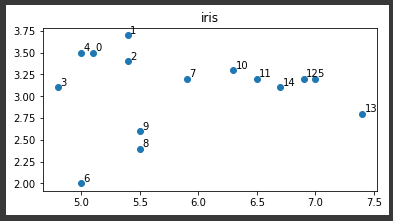

前回と同様にscikit-learnのアヤメのデータセットを読み込みます。

比較しやすくするために、サンプル数を10分の1に減らします。(4行目)

最後に散布図に表示します。(10行目)

[Google Colaboratory]

1 | from sklearn.datasets import load_iris |

[実行結果]

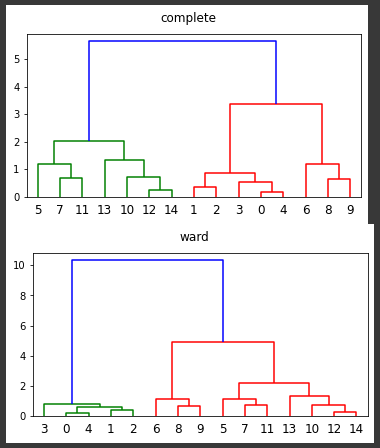

最長距離法とウォード法の比較

最長距離法とウォード法の両方でクラスタリングを行い、それぞれの樹形図を表示します。

最長距離法ではパラメータmethodに“complete”を指定(1行目)し、ウォード法では“ward”を指定(7行目)します。

[Google Colaboratory]

1 | Z = linkage(X, method="complete", metric="euclidean") |

[実行結果]

クラスタ数3として比較すると、まとまっている位置が変わっていますが同じように分類されているようです。

最長距離法は計算量が少なく、分類感度も比較的高いですが、拡散現象が生じることがあります。

拡散現象とはクラスターが大きくなるにつれ、他のデータと最長距離を多く持つようになり、次のクラスターの形成の候補に選ばれにくくなる現象です。