ボストン市の住宅価格をニューラルネットワークで予想してみます。

住宅価格のデータセットは13の特徴量(入力)と住宅価格(出力)のセットとなっています。

ニューラルネットワークは13の変数 x から1つの値 y を出力することになります。

学習は予測した価格と実際の住宅価格の差異が小さくなるようにパラメータを調整することで行います。

1 | import numpy as np |

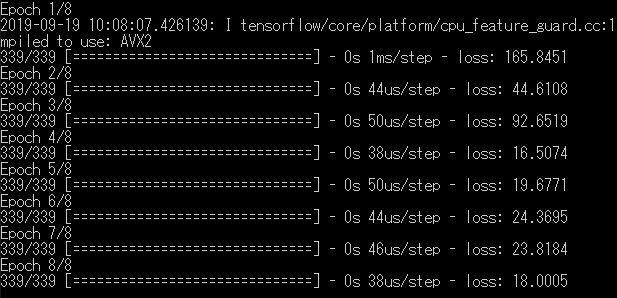

8回の学習で誤差が 165.8451 から 18.0005 まで減っていることがわかります。

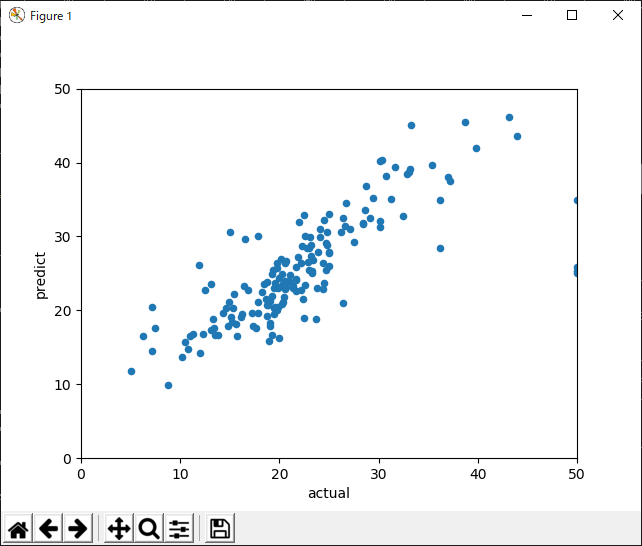

次に予測結果をグラフで確認します。

横軸 x が実際の住宅価格で、縦軸 y が予測した住宅価格となります。

完全に一致していれば対角線上にプロットされることになります。今回の予測はだいたいあっているようです。

参考

Pythonで学ぶ強化学習 -入門から実践まで- サンプルコード