TensorFlowで2層のニューラルネットワークを実装してみます。

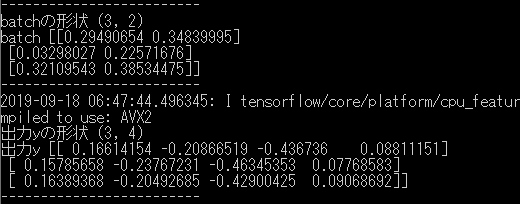

np.random.rand(3, 2)で3件の座標データbatchを作成しています。

また1層目から2層目にデータを送るときには、活性化関数(シグモイド)を適用しています。

1 | import numpy as np |

入力データbatchが3行2列(3件の座標データ)となり、出力データが3行4列(3件の4次元データ)となっていることがわかります。

このようにしてみると1行目に1件目の入力データと1件目の出力データが表示され、2行目に次の入力とその出力がされていて対応がわかりやすくなってます。

参考

Pythonで学ぶ強化学習 -入門から実践まで- サンプルコード