重回帰分析

重回帰分析 は、2つ以上の 説明変数(予測に使うデータ) から1つの 目的変数(予測するデータ) を予測する手法です。

重回帰分析 では、説明変数の数はいくつでもかまいませんが、説明変数が意味のあるものでなければ数を増やしても意味がありません。

説明変数は、前回記事で実施したように 相関関係 を調べて相関の強いものを使用すると、予測の精度 を高めることができます。

サンプルコード

重回帰分析 を行うサンプルコードは下記のようになります。

重回帰分析 も 単回帰分析 と同じように LinearRegressionオブジェクト に対して fitメソッド を実行することで行います。(11行目))

(CSVファイルは前回記事で使用したものを読み込みます。)

[Google Colaboratory]

1 | import pandas as pd |

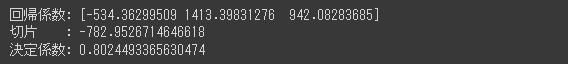

回帰係数 は、それぞれの説明変数の係数(目的変数に与える影響)となります。

絶対値で考えると、満足度(1413.39) が売上に与える影響が一番大きいことが確認できます。

決定係数 は 0.8024 となっており、3つの説明変数で 約80パーセント の確率で説明できることを表しています。