AnyTradingで参照すべき直前のデータ数を変更して、投資成績の変化を確認してみます。

参照する直前データ数を変更

参照すべき直前のデータ数を変更するには gym.make するときの window_size で指定します。

前回は 30 から 100 に変更してかなり成績が向上したので、今回はさらに 200 まで参照データ数を引き上げて検証してみます。

1 | import os, gym |

24行目 と 48行目 で、参照する直前のデータを 100 から 200 に変更しています。

FXトレードを実行

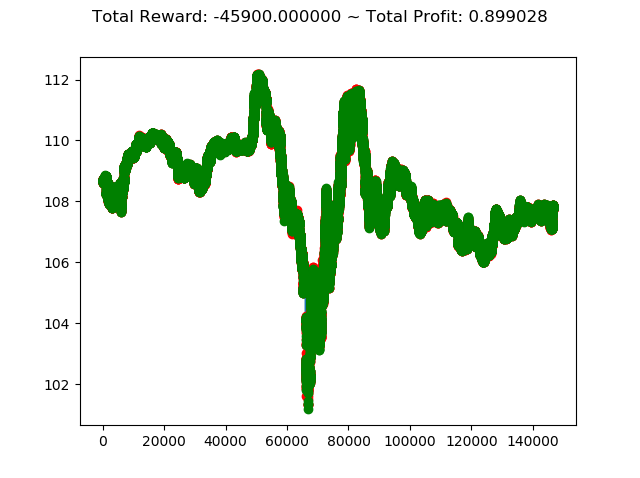

上記コードを実行すると次のような結果になります。

[コンソール出力]

1 | info: {'total_reward': -45900.000000015425, |

参照データ数を 30→100→200 と変化させたときの成績遷移は以下の通りです。

- トータル報酬 -68300 → 23400 → -45900

- トータル収益 0.907 → 0.992 → 0.899

今回は、トータル報酬とトータル収益ともに大幅に成績が悪化してしまいました。

単純に直前の参照データ数を上げても成績が上がるというわけではなさそうです。。。