AnyTrading は、FXや株式のトレーディングアルゴリズムのための強化学習環境です。

学習アルゴリズムを変更

今回は学習アルゴリズムを PPO2 から ACKTR に変更してみます。

1 | import os, gym |

8行目 でACKTRをインポートし、29行目 で学習アルゴリズムを PPO2 から ACKTR に変更しています。

学習アルゴリズムを変更してFXトレードを実行

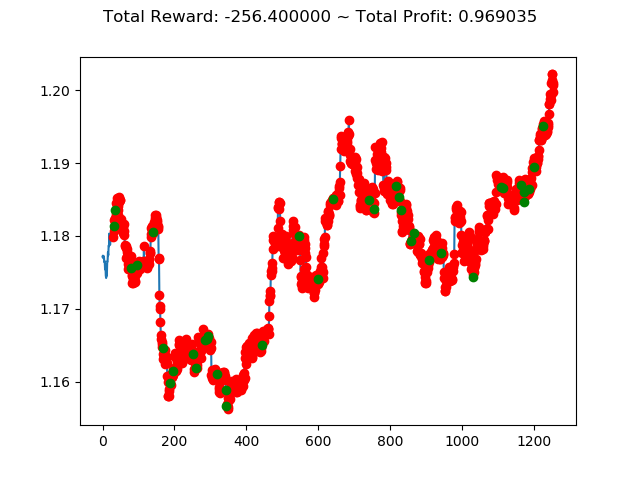

上記コードを実行すると次のような結果になります。

[コンソール出力]

1 | info: {'total_reward': -256.39999999998776, 'total_profit': 0.9690349314983275, 'position': 0} |

PPO2の結果と比較すると、ACKTRのFX売買結果は次のように変化しました。

- 累積報酬(total_reward)

359.6 → -256.3 - 純利益(total_profit)

0.94 → 0.969

累積報酬はかなり悪化し、純利益はややあがりました。

売買手法も買い(緑の丸)より、売り(赤の丸)の状態がほとんどで売買ロジックが全く違うことを見てとれます。