AnyTrading は、FXや株式のトレーディングアルゴリズムのための強化学習環境です。

前回はランダムでのFX売買を行いましたが、今回は学習してからFX売買を行ってみます。学習アルゴリズムは PPO2 を使います。

強化学習を行うコード

強化学習アルゴリズム PPO2 を使ってFX売買を実行するサンプルコードは次のようになります。

1 | import os, gym |

27行目で学習アルゴリズムPPO2を設定しています。

また、34行目で学習ステップ数を128000に設定し、45行目で学習済みモデルで次のアクションを決定しています。

PPO2で学習したモデルを使ってFXトレードを実行

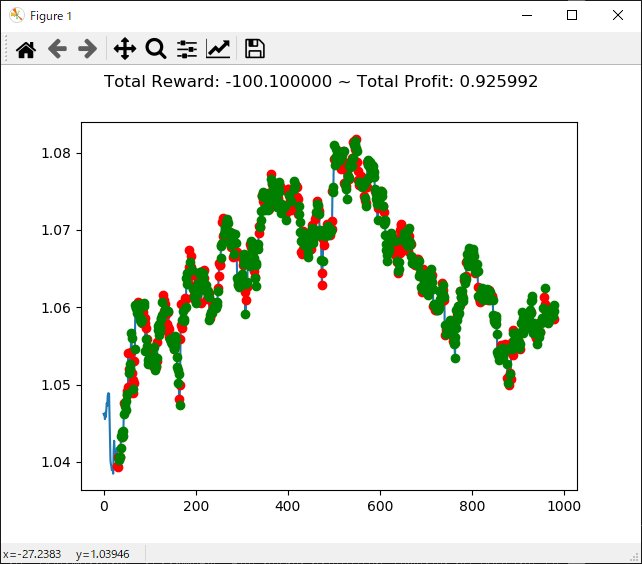

上記コードを実行すると次のような結果になります。

[コンソール出力]

1 | info: {'total_reward': -100.099999999994, 'total_profit': 0.9259919709534984, 'position': 1} |

前回のランダム実行と比べると、今回の強化学習によるFX売買結果は次のようになりました。

- 累積報酬(total_reward)

-76 → -100 - 純利益(total_profit)

0.98 → 0.92

ランダム実行より成績が落ちてしまいました。(;^_^A

ここからいろいろパラメータを変えて、成績の改善を目指していきます。